- Главная

- Разное

- Образование

- Спорт

- Естествознание

- Природоведение

- Религиоведение

- Французский язык

- Черчение

- Английский язык

- Астрономия

- Алгебра

- Биология

- География

- Геометрия

- Детские презентации

- Информатика

- История

- Литература

- Математика

- Музыка

- МХК

- Немецкий язык

- ОБЖ

- Обществознание

- Окружающий мир

- Педагогика

- Русский язык

- Технология

- Физика

- Философия

- Химия

- Шаблоны, фоны, картинки для презентаций

- Экология

- Экономика

Презентация, доклад по информатике 10 класс Измерение количества информации

Содержание

- 1. Презентация по информатике 10 класс Измерение количества информации

- 2. Ральф Винтон Лайон ХартлиВозникновение и прием информации

- 3. Законы Хартли1. Если можно выбрать только один

- 4. I=log2NВ этом подходе за единицу информации принимается

- 5. Клод Элвуд ШеннонШеннон обобщил формулу Хартли, рассчитав

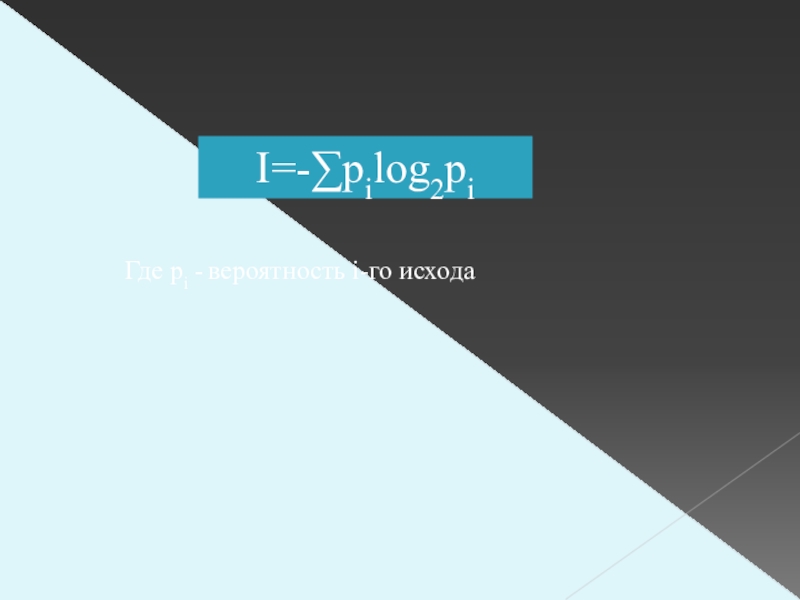

- 6. I=-∑pilog2piГде pi - вероятность i-го исхода

- 7. Если оценивать информацию как снятую неопределенность, количество

- 8. Измерение целесообразности информацииКлючевой идеей является измерение не самого сообщения, а измерения вероятности достижения некоторой целиI=log2p1/p2

Ральф Винтон Лайон ХартлиВозникновение и прием информации связаны с устранением неопределенности в выборе одного из нескольких возможных вариантов

Слайд 2Ральф Винтон Лайон Хартли

Возникновение и прием информации связаны с устранением неопределенности

в выборе одного из нескольких возможных вариантов

Слайд 3Законы Хартли

1. Если можно выбрать только один заранее всем известный вариант,

то количество информации при таком выборе равно нулю

2. Чем больше количество возможных вариантов, тем больше информации содержится в сообщении о выборе конкретного варианта

3. Количество информации, содержащейся в сообщении о результатах нескольких независимых выборов, должно быть равно сумме количеств информации, содержащейся в сообщениях об этих выборов по отдельности.

2. Чем больше количество возможных вариантов, тем больше информации содержится в сообщении о выборе конкретного варианта

3. Количество информации, содержащейся в сообщении о результатах нескольких независимых выборов, должно быть равно сумме количеств информации, содержащейся в сообщениях об этих выборов по отдельности.

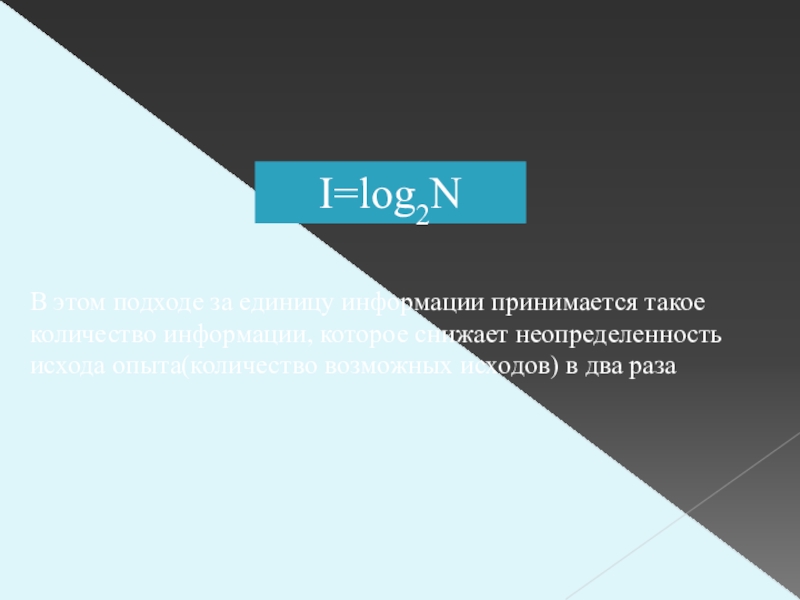

Слайд 4I=log2N

В этом подходе за единицу информации принимается такое количество информации, которое

снижает неопределенность исхода опыта(количество возможных исходов) в два раза

Слайд 5Клод Элвуд Шеннон

Шеннон обобщил формулу Хартли, рассчитав средневзвешенное количество информации, получаемое

из опыта, где не все исходы равновероятны

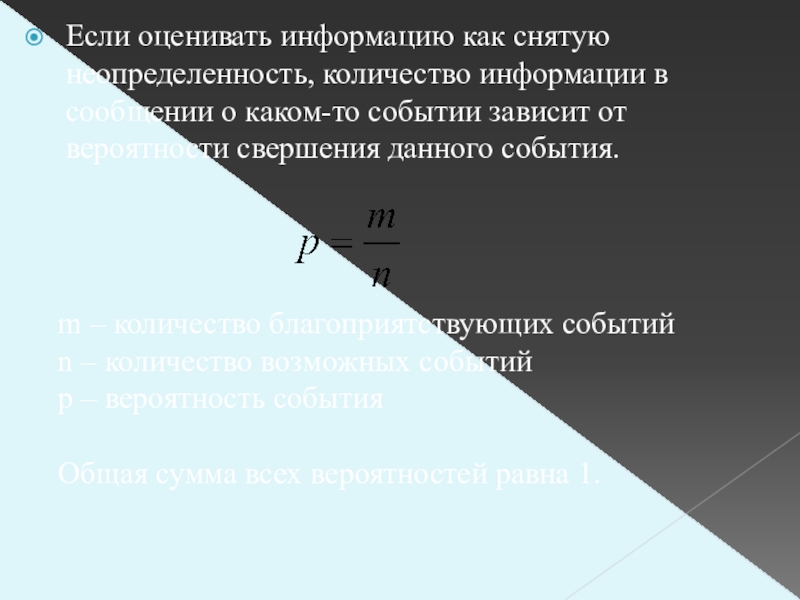

Слайд 7Если оценивать информацию как снятую неопределенность, количество информации в сообщении о

каком-то событии зависит от вероятности свершения данного события.

m – количество благоприятствующих событий

n – количество возможных событий

p – вероятность события

Общая сумма всех вероятностей равна 1.

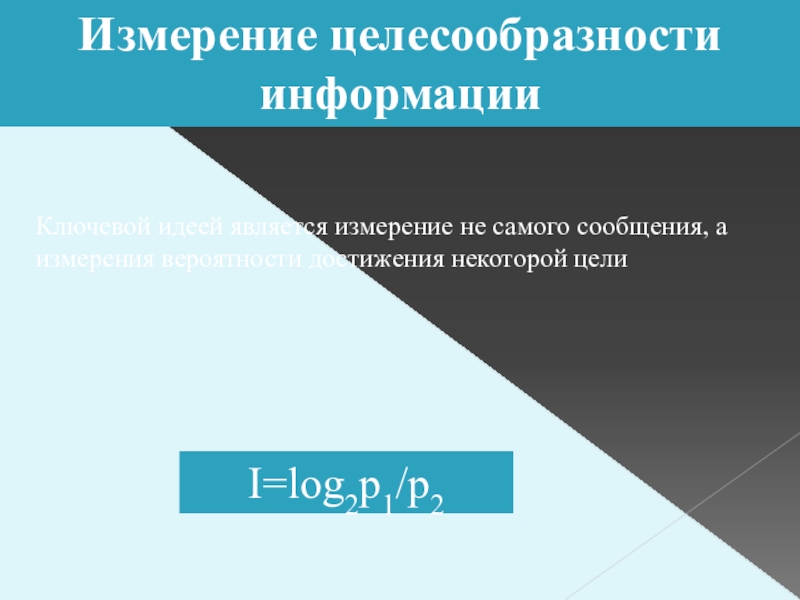

Слайд 8Измерение целесообразности информации

Ключевой идеей является измерение не самого сообщения, а измерения

вероятности достижения некоторой цели

I=log2p1/p2