- Главная

- Разное

- Образование

- Спорт

- Естествознание

- Природоведение

- Религиоведение

- Французский язык

- Черчение

- Английский язык

- Астрономия

- Алгебра

- Биология

- География

- Геометрия

- Детские презентации

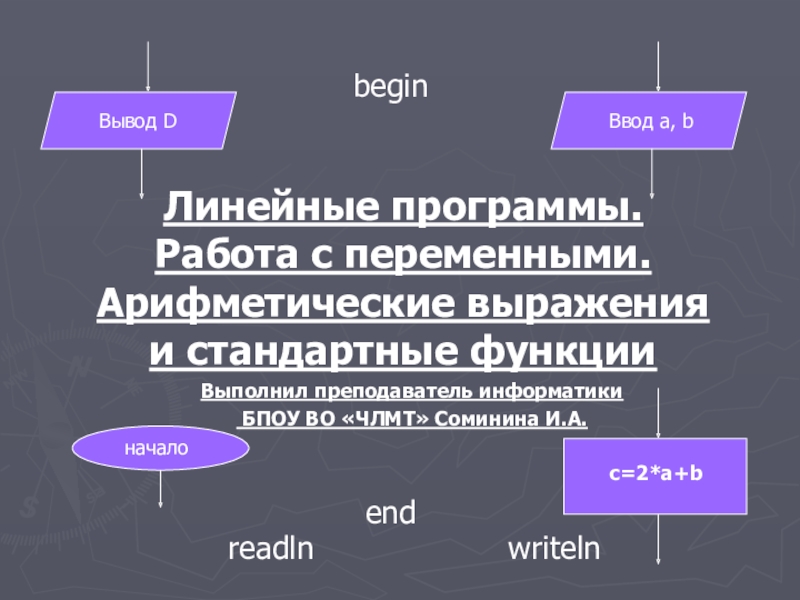

- Информатика

- История

- Литература

- Математика

- Музыка

- МХК

- Немецкий язык

- ОБЖ

- Обществознание

- Окружающий мир

- Педагогика

- Русский язык

- Технология

- Физика

- Философия

- Химия

- Шаблоны, фоны, картинки для презентаций

- Экология

- Экономика

Презентация, доклад Алфавитный и содержательный подход в определении количества информации

Содержание

- 1. Презентация Алфавитный и содержательный подход в определении количества информации

- 2. Уменьшение неопределённости знания. Подход к информации

- 3. Это сообщение приводит к уменьшению неопределённости нашего

- 4. Уменьшение неопределённости знания. При

- 5. Возможные и произошедшее события.

- 6. Единицы измерения количества информации. Для количественного выражения

- 7. В информатике система образования кратных единиц измерения

- 8. Слайд 8

- 9. Однако при хранении и передаче информации с

- 10. Так, в русском алфавите, если не использовать

Уменьшение неопределённости знания. Подход к информации как к мере уменьшения неопределённости знания позволяет количественно измерять информацию. Пусть у нас имеется монета, которую мы бросаем на ровную поверхность. С равной вероятностью произойдёт одно из двух возможных

Слайд 2Уменьшение неопределённости знания. Подход к информации как к мере уменьшения неопределённости

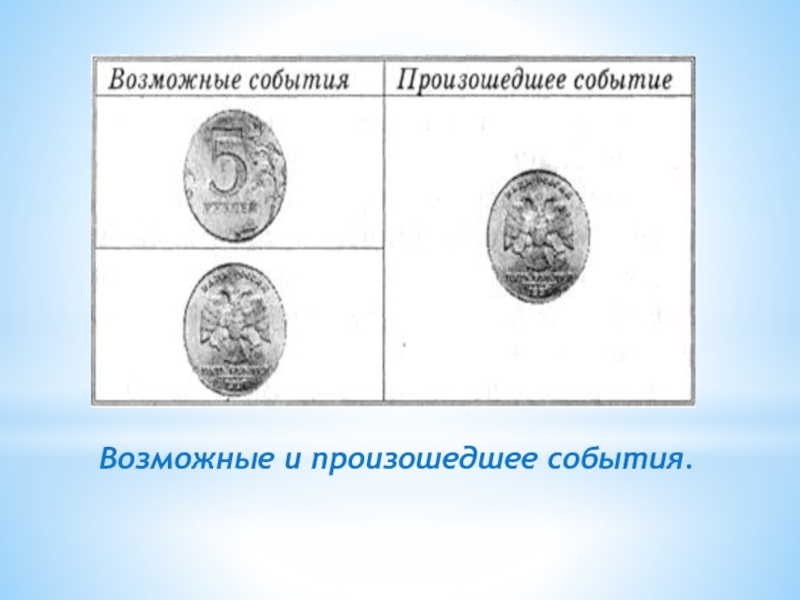

знания позволяет количественно измерять информацию. Пусть у нас имеется монета, которую мы бросаем на ровную поверхность. С равной вероятностью произойдёт одно из двух возможных событий – монета окажется в одном из двух положений: "орёл" или "решка". События равновероятны, если при возрастающем числе опытов число выпадений "орла" и "решки" постепенно сближаются. Перед броском существует неопределённость нашего знания (возможны 2 события), и как упадёт монета – предсказать невозможно. После броска наступает полная определённость, т.к. мы видим, что монета в данный момент находится в определённом положении.

Слайд 3Это сообщение приводит к уменьшению неопределённости нашего знания в 2 раза,

т.к. из двух возможных равновероятных событий реализовалось одно. В окружающей действительности часто встречаются ситуации, когда может произойти большее, чем 2, число равновероятных событий. Чем больше начальное число возможных равновероятных событий, тем больше начальная неопределённость нашего знания и тем большее количество информации будет содержать сообщение о результатах опыта.

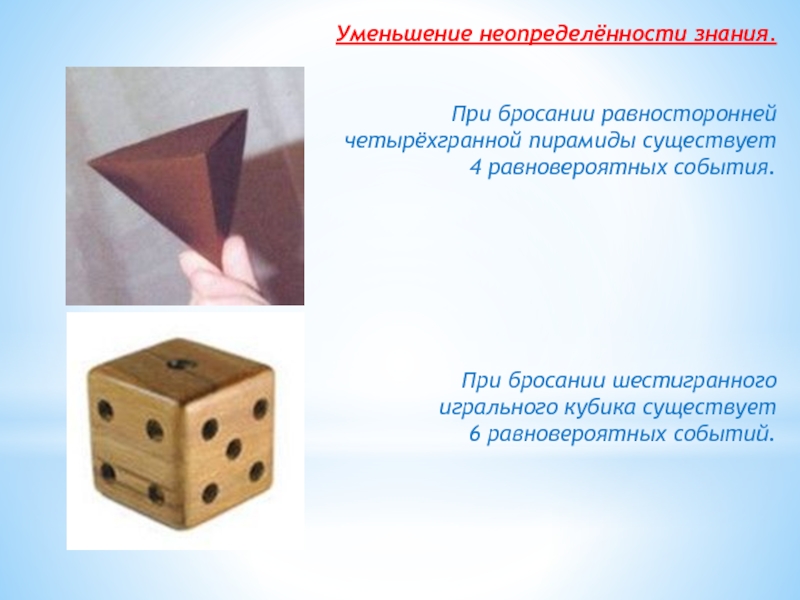

Слайд 4Уменьшение неопределённости знания. При бросании равносторонней четырёхгранной пирамиды существует 4 равновероятных события. При бросании

шестигранного

игрального кубика существует

6 равновероятных событий.

Слайд 6Единицы измерения количества информации. Для количественного выражения любой величины необходимо определить единицу

измерения. Так, для измерения длины в качестве единицы выбран метр, для измерения массы - килограмм и так далее. Аналогично, для определения количества информации необходимо ввести единицу измерения.

За единицу количества информации принимается такое количество информации, которое содержит сообщение, уменьшающее неопределенность в два раза. Такая единица названа "бит".

Если вернуться к опыту с бросанием монеты, то здесь неопределенность как раз уменьшается в два раза и, следовательно, полученное количество информации равно 1 биту.

Минимальной единицей измерения количества информации является бит, а следующей по величине единицей является байт, причем

1 байт = 23 бит = 8 бит

За единицу количества информации принимается такое количество информации, которое содержит сообщение, уменьшающее неопределенность в два раза. Такая единица названа "бит".

Если вернуться к опыту с бросанием монеты, то здесь неопределенность как раз уменьшается в два раза и, следовательно, полученное количество информации равно 1 биту.

Минимальной единицей измерения количества информации является бит, а следующей по величине единицей является байт, причем

1 байт = 23 бит = 8 бит

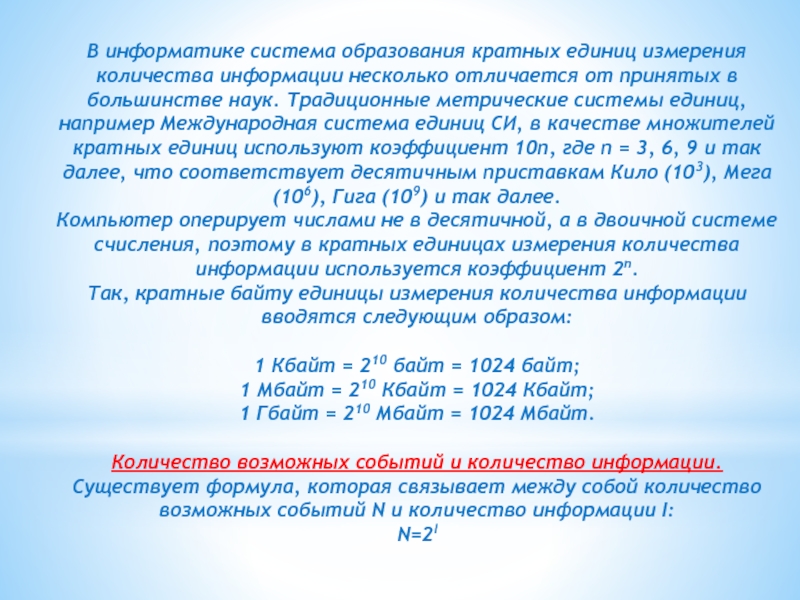

Слайд 7В информатике система образования кратных единиц измерения количества информации несколько отличается

от принятых в большинстве наук. Традиционные метрические системы единиц, например Международная система единиц СИ, в качестве множителей кратных единиц используют коэффициент 10n, где п = 3, 6, 9 и так далее, что соответствует десятичным приставкам Кило (103), Мега (106), Гига (109) и так далее.

Компьютер оперирует числами не в десятичной, а в двоичной системе счисления, поэтому в кратных единицах измерения количества информации используется коэффициент 2n.

Так, кратные байту единицы измерения количества информации вводятся следующим образом:

1 Кбайт = 210 байт = 1024 байт;

1 Мбайт = 210 Кбайт = 1024 Кбайт;

1 Гбайт = 210 Мбайт = 1024 Мбайт.

Количество возможных событий и количество информации. Существует формула, которая связывает между собой количество возможных событий N и количество информации I:

N=2I

Слайд 8

При определении количества информации на основе уменьшения неопределенности наших знаний мы рассматриваем информацию с точки зрения содержания, ее понятности и новизны для человека. С этой точки зрения в опыте по бросанию монеты одинаковое количество информации содержится и в зрительном образе упавшей монеты, и в коротком сообщении "Орел", и в длинной фразе "Монета упала на поверхность земли той стороной вверх, на которой изображен орел".

Слайд 9Однако при хранении и передаче информации с помощью технических устройств целесообразно

отвлечься от содержания информации и рассматривать ее как последовательность знаков (букв, цифр, кодов цветов точек изображения и так далее).

Набор символов знаковой системы (алфавит) можно рассматривать как различные возможные состояния (события). Тогда, если считать, что появление символов в сообщении равновероятно, по формуле (2.1) можно рассчитать, какое количество информации несет каждый символ.

Слайд 10Так, в русском алфавите, если не использовать букву ё, количество событий

(букв) будет равно 32. Тогда:

32 = 2I, откуда I = 5 битов.

Каждый символ несет 5 битов информации (его информационная емкость равна 5 битов). Количество информации в сообщении можно подсчитать, умножив количество информации, которое несет один символ, на количество символов.

Количество информации, которое содержит сообщение, закодированное с помощью знаковой системы, равно количеству информации, которое несет один знак, умноженному на количество знаков.