- Главная

- Разное

- Образование

- Спорт

- Естествознание

- Природоведение

- Религиоведение

- Французский язык

- Черчение

- Английский язык

- Астрономия

- Алгебра

- Биология

- География

- Геометрия

- Детские презентации

- Информатика

- История

- Литература

- Математика

- Музыка

- МХК

- Немецкий язык

- ОБЖ

- Обществознание

- Окружающий мир

- Педагогика

- Русский язык

- Технология

- Физика

- Философия

- Химия

- Шаблоны, фоны, картинки для презентаций

- Экология

- Экономика

Презентация, доклад на тему Мультимедийная презентация по информатике на тему Измерение количества информации

Содержание

- 1. Мультимедийная презентация по информатике на тему Измерение количества информации

- 2. Как измерить информацию?Что такое «много информации» и

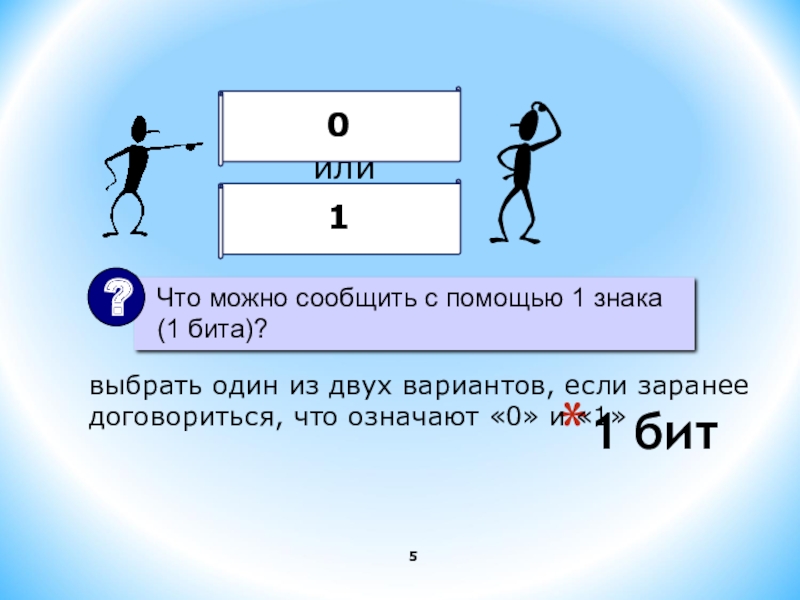

- 3. Какой код использовать?Идея: использовать тот код, который применяется в компьютерной технике«0»«1»

- 4. Двоичный кодКод, в котором используются только два

- 5. 1 битиливыбрать один из двух вариантов, если заранее договориться, что означают «0» и «1»

- 6. Единицы измерения1 бит – это количество информации,

- 7. Сколько информации?Определите количество информации:2 бита5 битов7 битов10 битов

- 8. Сколько вариантов?1 бит:2 бита:3 бита:4 бита: 16 вариантов! 0 1000 0110 11000 001010 011100 101110 111

- 9. Если вариантов больше…4 варианта – 2 бита000110118

- 10. Если вариантов больше…«Да» или «Нет»?2 варианта –

- 11. Если вариантов больше…6 вариантов – между 4

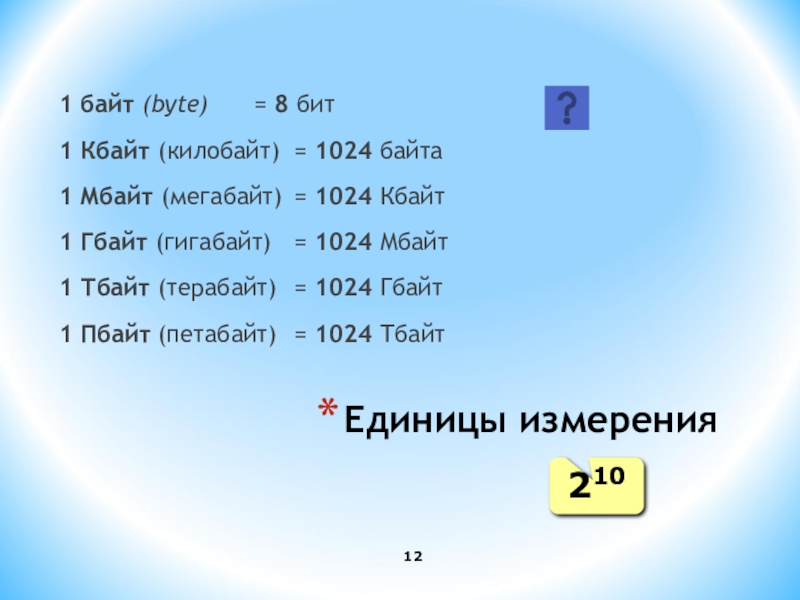

- 12. Единицы измерения1 байт (bytе) =

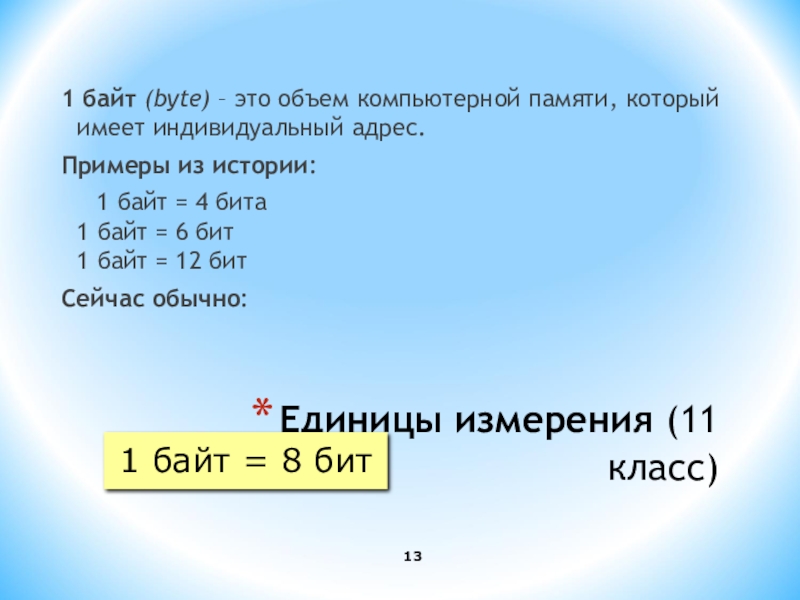

- 13. Единицы измерения (11 класс)1 байт (bytе) –

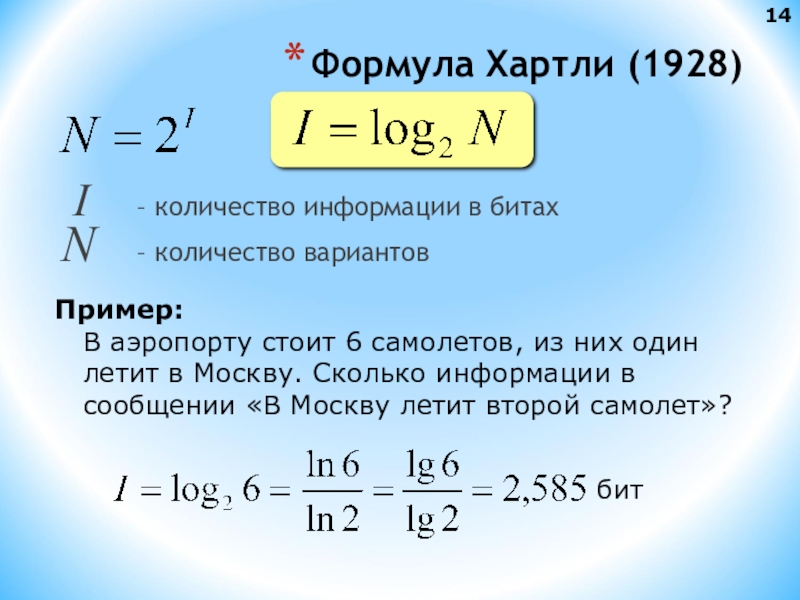

- 14. Формула Хартли (1928) I – количество

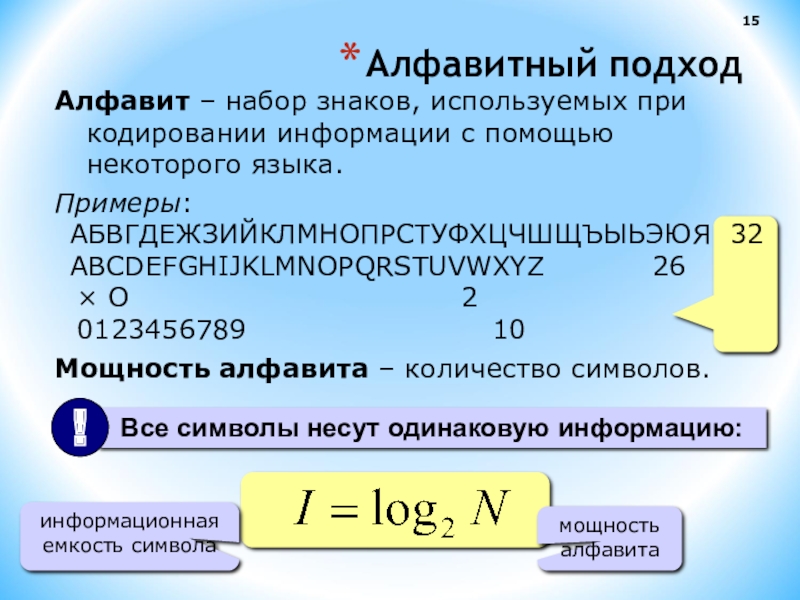

- 15. Алфавит – набор знаков, используемых при кодировании

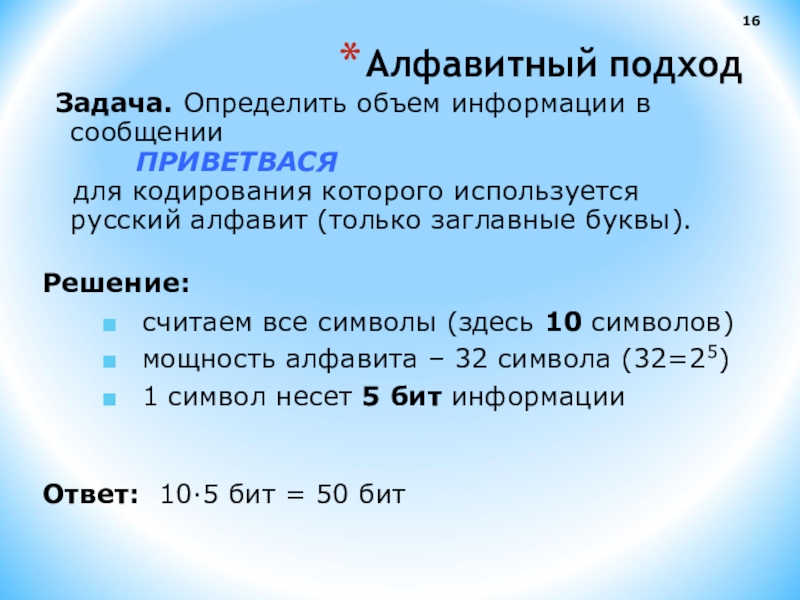

- 16. Алфавитный подходЗадача. Определить объем информации в сообщении ПРИВЕТВАСЯ

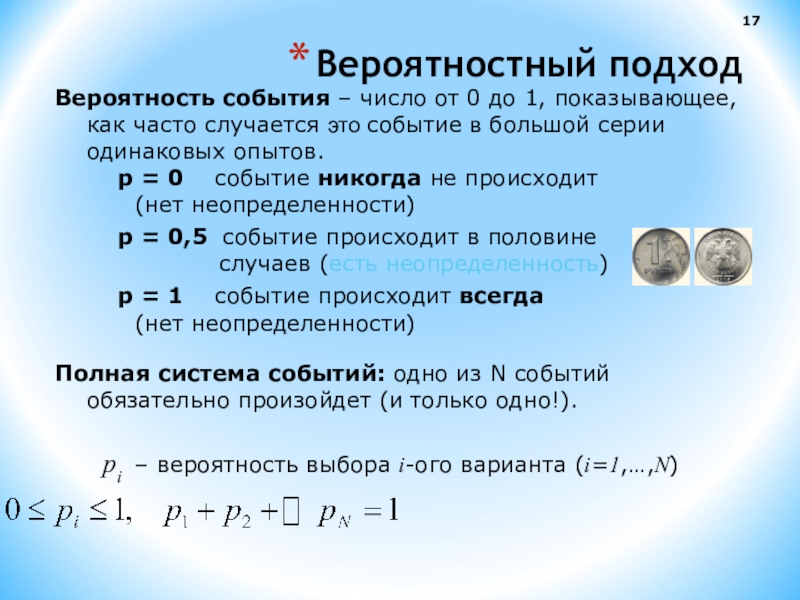

- 17. Вероятность события – число от 0 до

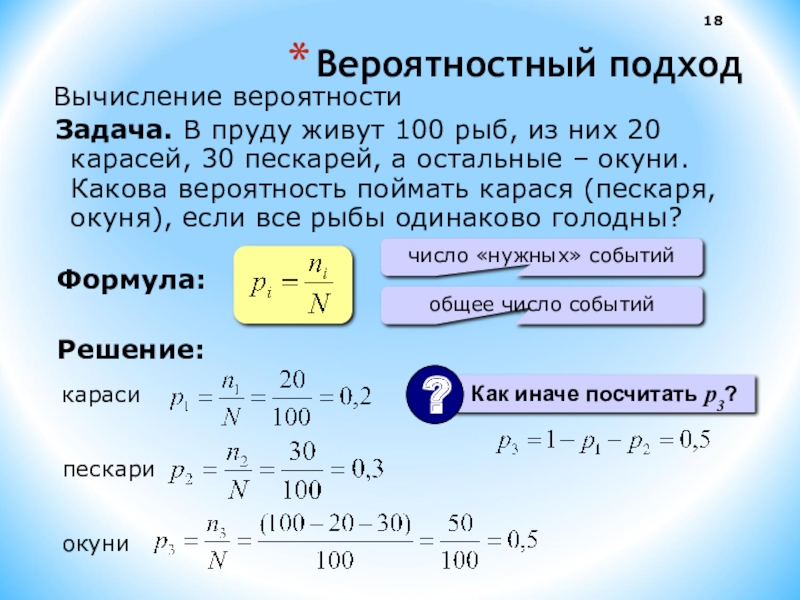

- 18. Вероятностный подходВычисление вероятностиЗадача. В пруду живут 100

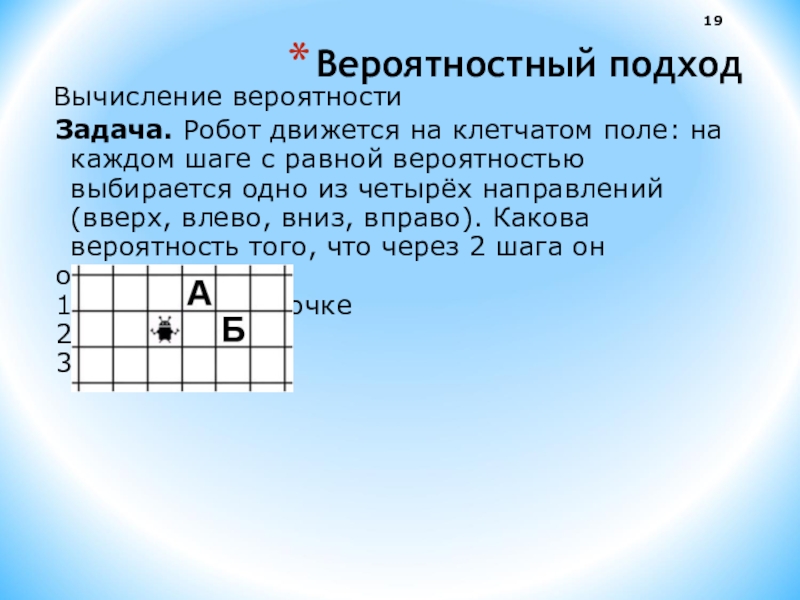

- 19. Вероятностный подходВычисление вероятностиЗадача. Робот движется на клетчатом

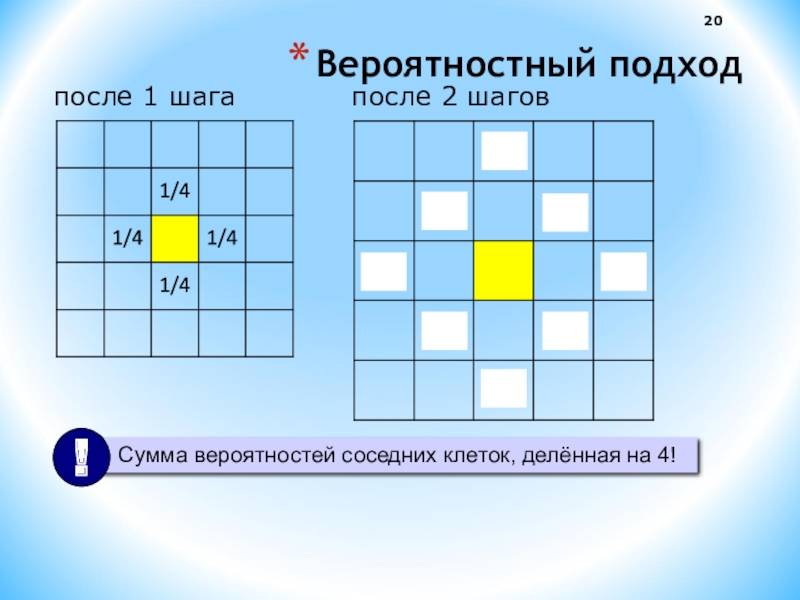

- 20. Вероятностный подходпосле 1 шагапосле 2 шагов

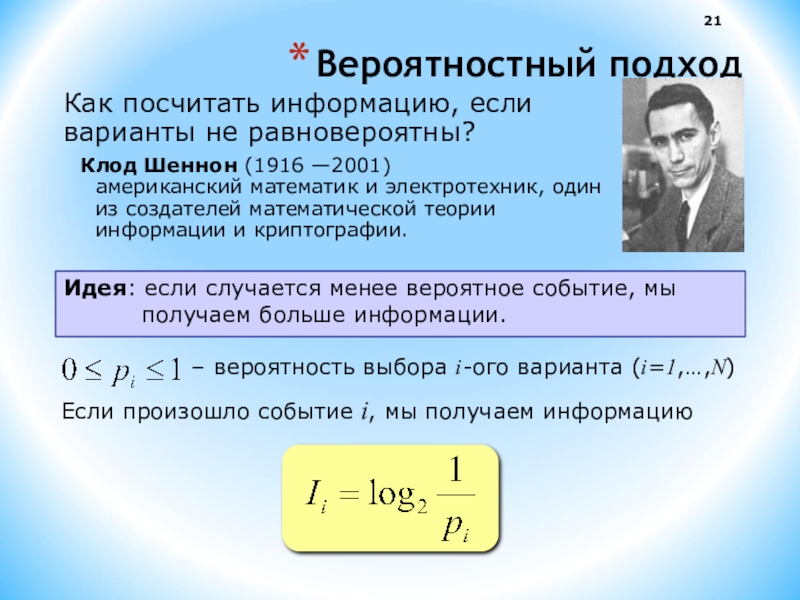

- 21. Вероятностный подходКак посчитать информацию, если варианты не

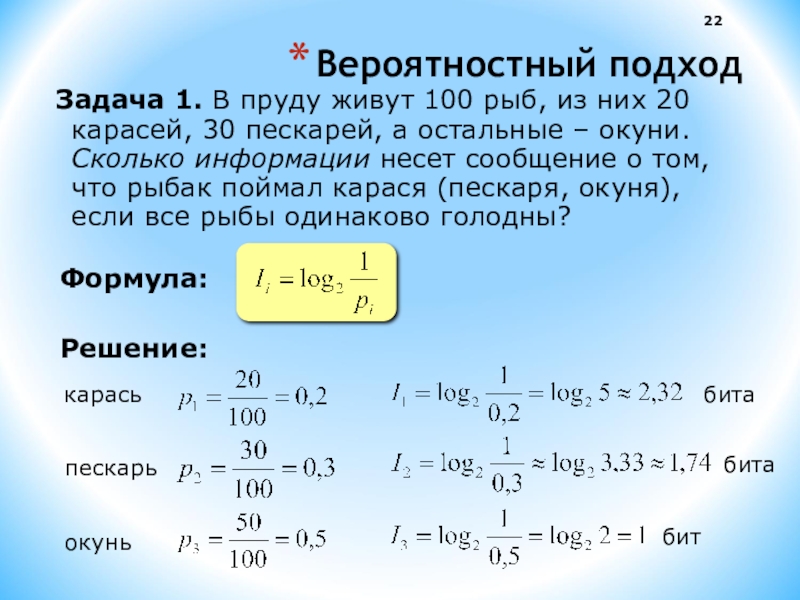

- 22. Вероятностный подходЗадача 1. В пруду живут 100

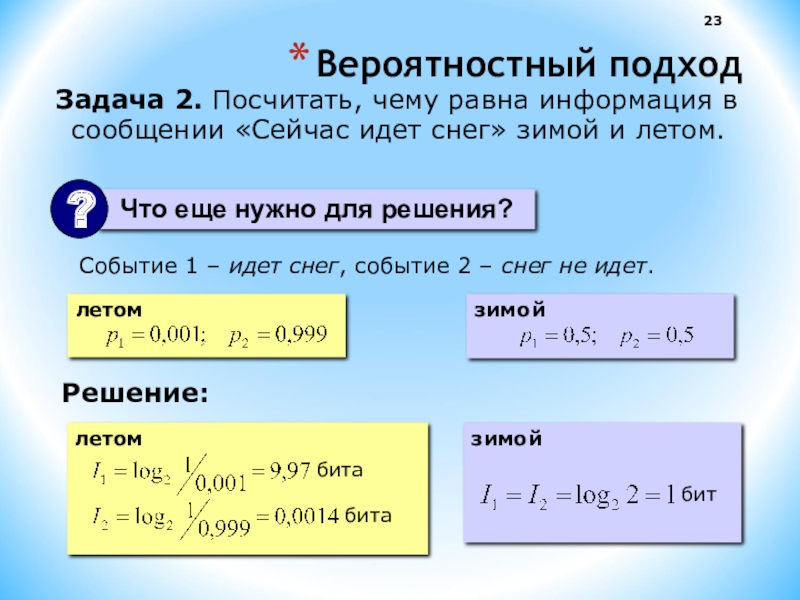

- 23. Вероятностный подходЗадача 2. Посчитать, чему равна информация

- 24. Два подхода: сравнениеЗадача 3. Отличник Вася Пупкин

- 25. Два подхода: сравнениеВероятностный подход:задаем вероятности получения

- 26. Информация и знаниезнаниенезнаниеполучение информациизнаниенезнаниеНеопределенность – недостаток

- 27. Формула Шеннона (1948)Неопределенность (энтропия системы)Система двух событий:

- 28. Семантическая теорияЮ.А. Шрейдер:Тезаурус – знания приемника информации

Слайд 2Как измерить информацию?

Что такое «много информации» и «мало информации»?

Как определить, в

Идея:

количество информации определяется временем ее передачи

количество информации – это длина сообщения, с помощью которого её можно закодировать.

От чего зависит длина сообщения?

от алфавита!

Какой алфавит выбрать?

абвг…эюя?

abcd…xyz?

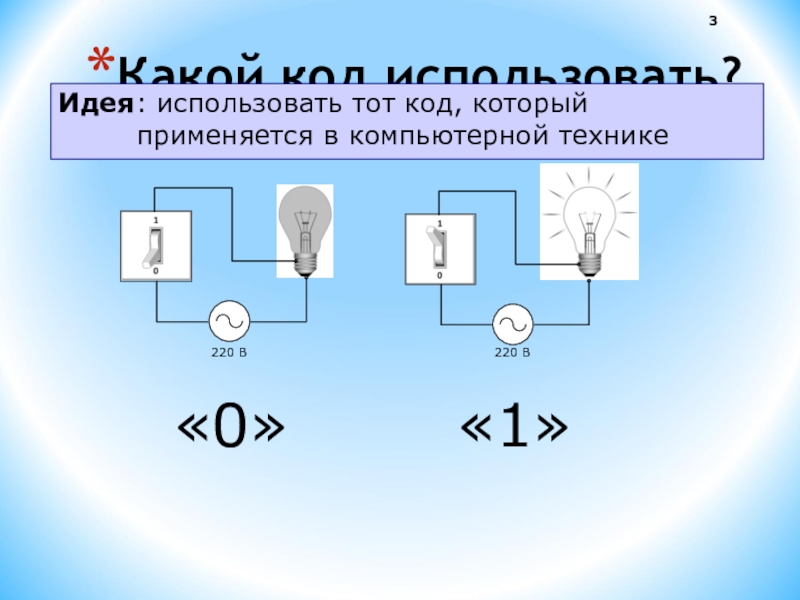

Слайд 3Какой код использовать?

Идея: использовать тот код, который применяется в компьютерной технике

«0»

«1»

Слайд 4Двоичный код

Код, в котором используются только два знака, называется двоичным. Все

1 бит – это количество информации, которое можно передать с помощью одного знака в двоичном коде («0» или «1»).

bit = binary digit, двоичная цифра

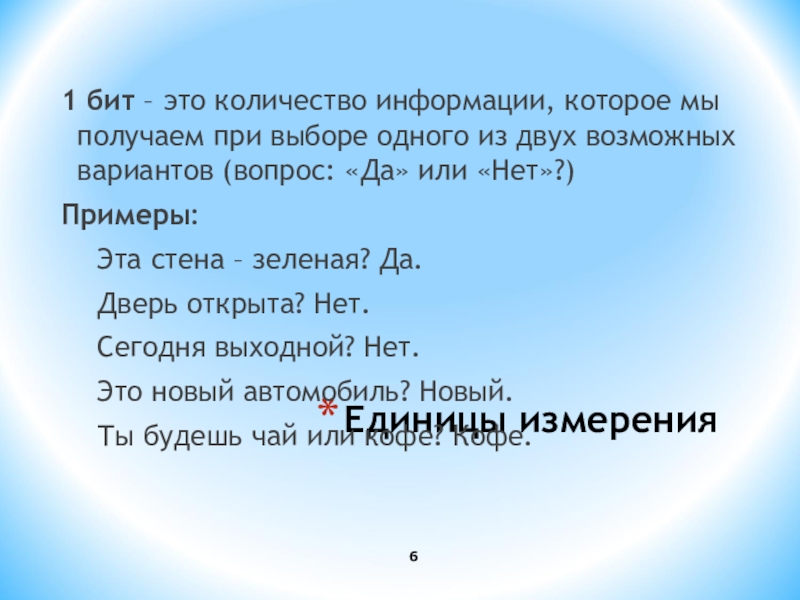

Слайд 6Единицы измерения

1 бит – это количество информации, которое мы получаем при

Примеры:

Эта стена – зеленая? Да.

Дверь открыта? Нет.

Сегодня выходной? Нет.

Это новый автомобиль? Новый.

Ты будешь чай или кофе? Кофе.

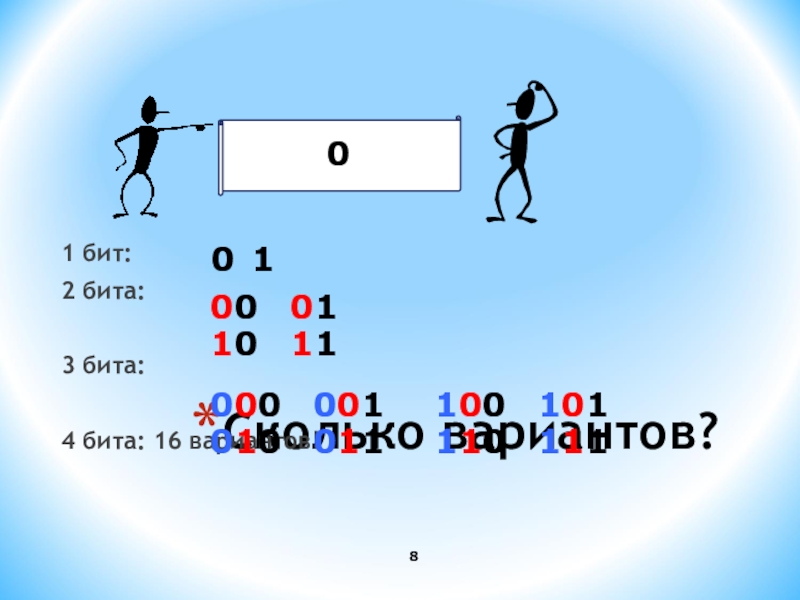

Слайд 8Сколько вариантов?

1 бит:

2 бита:

3 бита:

4 бита: 16 вариантов!

0 1

0

00 01

10 11

000 001

010 011

100 101

110

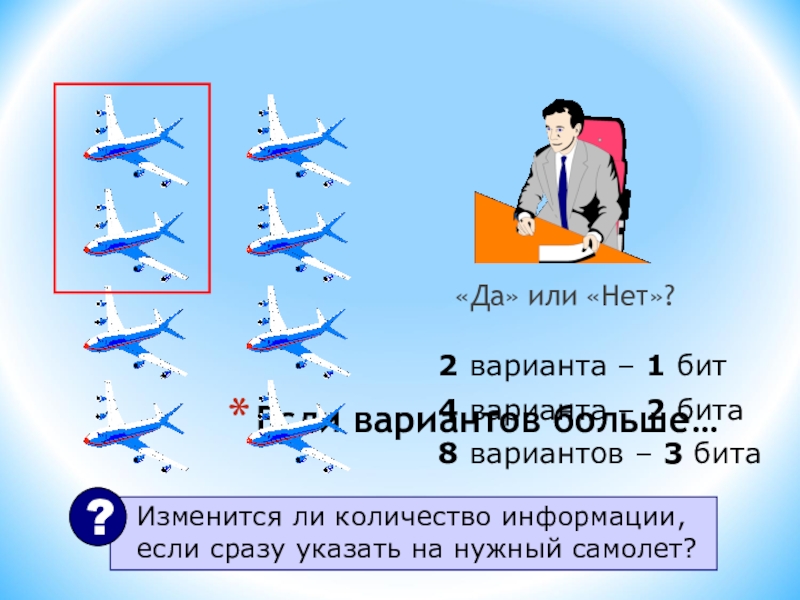

Слайд 9Если вариантов больше…

4 варианта – 2 бита

00

01

10

11

8 вариантов – 3 бита

?

16

?

32 варианта – 5 бит

?

64 варианта – 6 бит

?

128 вариантов – 7 бит

?

Слайд 10Если вариантов больше…

«Да» или «Нет»?

2 варианта – 1 бит

4 варианта –

8 вариантов – 3 бита

Слайд 11Если вариантов больше…

6 вариантов – между 4 (2 бита) и 8

Ответ: количество информации между

2 и 3 битами

Слайд 12Единицы измерения

1 байт (bytе) = 8 бит

1 Кбайт (килобайт)

1 Мбайт (мегабайт) = 1024 Кбайт

1 Гбайт (гигабайт) = 1024 Мбайт

1 Тбайт (терабайт) = 1024 Гбайт

1 Пбайт (петабайт) = 1024 Тбайт

210

Слайд 13Единицы измерения (11 класс)

1 байт (bytе) – это объем компьютерной памяти,

Примеры из истории:

1 байт = 4 бита 1 байт = 6 бит 1 байт = 12 бит

Сейчас обычно:

1 байт = 8 бит

Слайд 14Формула Хартли (1928)

I – количество информации в битах

N –

Пример:

В аэропорту стоит 6 самолетов, из них один

летит в Москву. Сколько информации в

сообщении «В Москву летит второй самолет»?

бит

Слайд 15

Алфавит – набор знаков, используемых при кодировании информации с помощью некоторого

Примеры:

АБВГДЕЖЗИЙКЛМНОПРСТУФХЦЧШЩЪЫЬЭЮЯ 32

ABCDEFGHIJKLMNOPQRSTUVWXYZ 26

× O 2

0123456789 10

Мощность алфавита – количество символов.

Алфавитный подход

мощность алфавита

информационная емкость символа

Слайд 16Алфавитный подход

Задача. Определить объем информации в сообщении

ПРИВЕТВАСЯ

для кодирования которого используется

Ответ: 10·5 бит = 50 бит

считаем все символы (здесь 10 символов)

мощность алфавита – 32 символа (32=25)

1 символ несет 5 бит информации

Решение:

Слайд 17Вероятность события – число от 0 до 1, показывающее, как часто

p = 0 событие никогда не происходит (нет неопределенности)

p = 0,5 событие происходит в половине случаев (есть неопределенность)

p = 1 событие происходит всегда (нет неопределенности)

Полная система событий: одно из N событий обязательно произойдет (и только одно!).

Вероятностный подход

pi – вероятность выбора i-ого варианта (i=1,…,N)

Слайд 18Вероятностный подход

Вычисление вероятности

Задача. В пруду живут 100 рыб, из них 20

Формула:

число «нужных» событий

общее число событий

Решение:

караси

пескари

окуни

Слайд 19Вероятностный подход

Вычисление вероятности

Задача. Робот движется на клетчатом поле: на каждом шаге

окажется

1) в начальной точке

2) в точке А?

3) в точке Б?

Слайд 21Вероятностный подход

Как посчитать информацию, если варианты не равновероятны?

Идея: если случается менее

Если произошло событие i, мы получаем информацию

Клод Шеннон (1916 —2001)

американский математик и электротехник, один из создателей математической теории информации и криптографии.

Слайд 22Вероятностный подход

Задача 1. В пруду живут 100 рыб, из них 20

Формула:

Решение:

карась

пескарь

окунь

Слайд 23Вероятностный подход

Задача 2. Посчитать, чему равна информация в сообщении «Сейчас идет

Решение:

Событие 1 – идет снег, событие 2 – снег не идет.

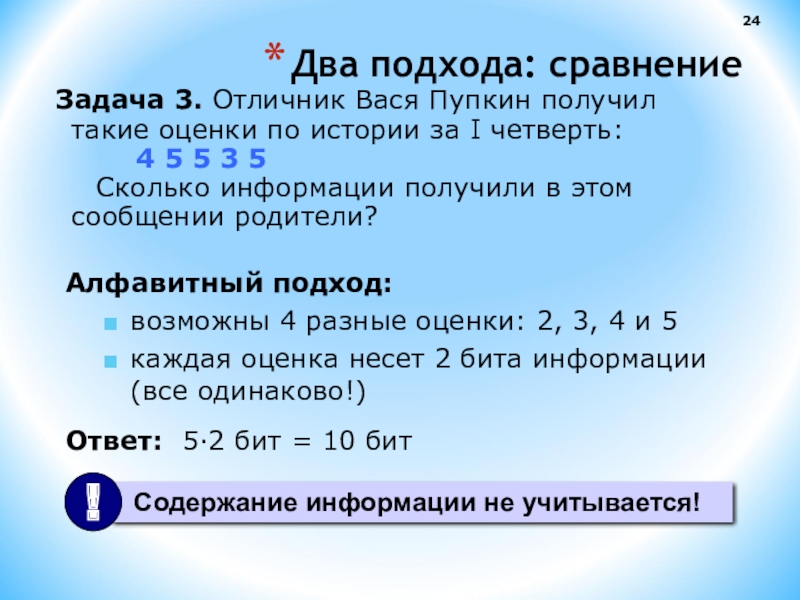

Слайд 24Два подхода: сравнение

Задача 3. Отличник Вася Пупкин получил такие оценки по

4 5 5 3 5

Сколько информации получили в этом сообщении родители?

Алфавитный подход:

возможны 4 разные оценки: 2, 3, 4 и 5

каждая оценка несет 2 бита информации (все одинаково!)

Ответ: 5·2 бит = 10 бит

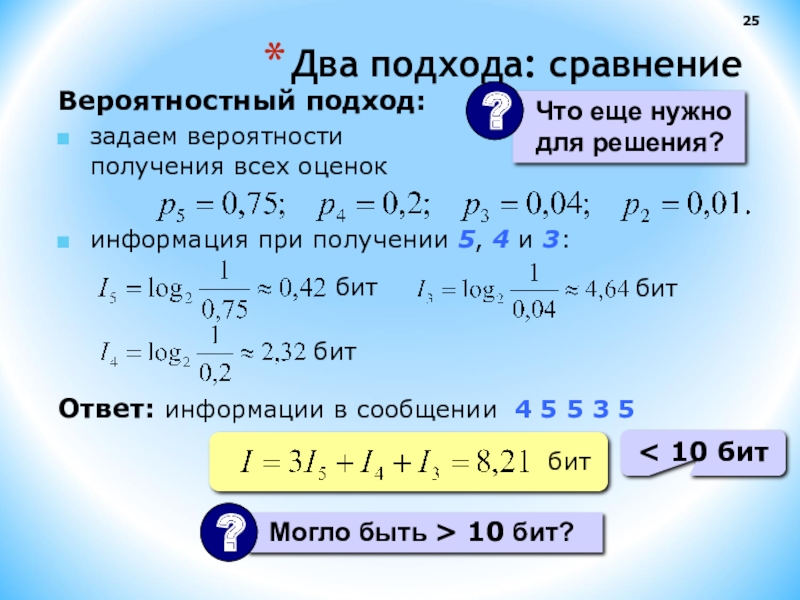

Слайд 25Два подхода: сравнение

Вероятностный подход:

задаем вероятности

получения всех оценок

информация при получении 5,

бит

бит

бит

< 10 бит

Ответ: информации в сообщении 4 5 5 3 5

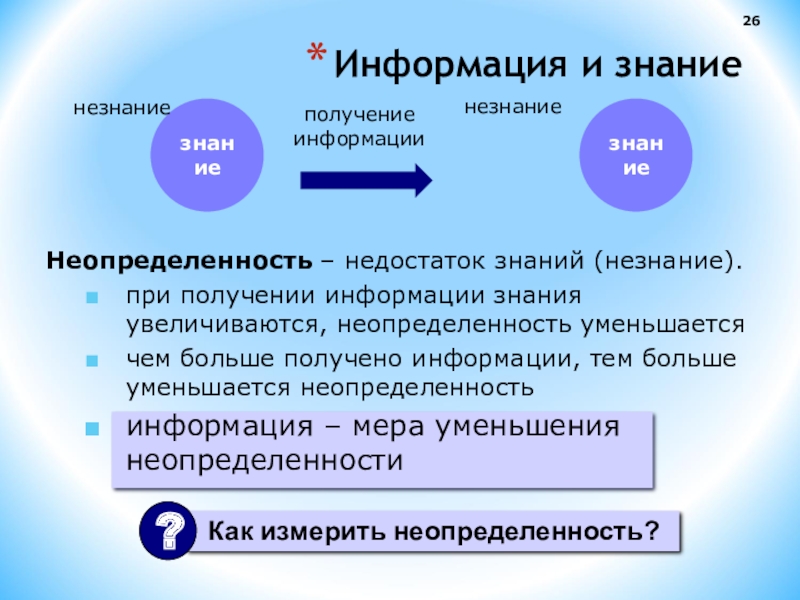

Слайд 26

Информация и знание

знание

незнание

получение

информации

знание

незнание

Неопределенность – недостаток знаний (незнание).

при получении информации знания

чем больше получено информации, тем больше уменьшается неопределенность

информация – мера уменьшения неопределенности

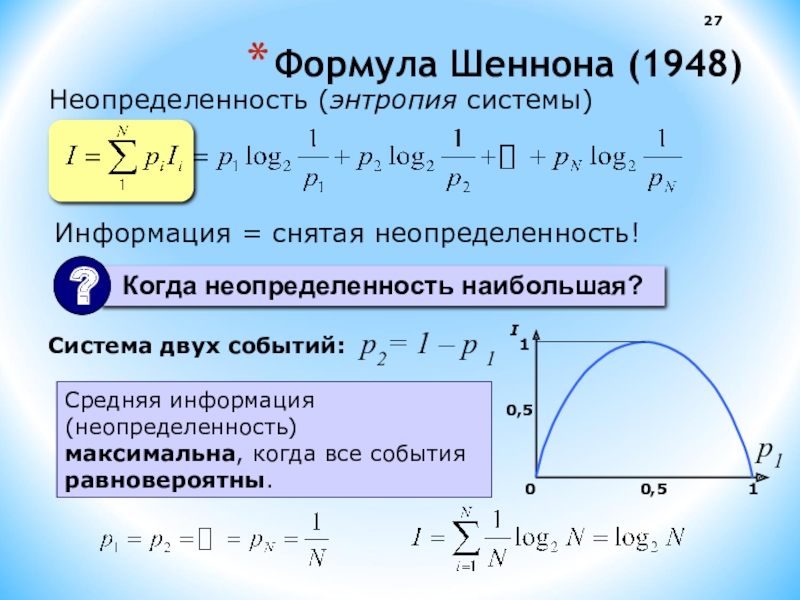

Слайд 27Формула Шеннона (1948)

Неопределенность (энтропия системы)

Система двух событий:

Средняя информация (неопределенность) максимальна,

p1

p2= 1 – p 1

Информация = снятая неопределенность!